📖 AdvAD

Cite as: NeurIPS 2024

REF: https://arxiv.org/pdf/2503.09124

Abstract

Novel Approach: Models adversarial attacks as a non-parametric diffusion process instead of using traditional denoising or generative methods.

Efficient Design: Creates effective adversarial guidance using only the target model without additional networks.

Superior Results: Achieves high attack success with inherently lower perturbation strength and better imperceptibility.

傳統擴散模型:主要用於圖像生成或去噪,依賴一個經過訓練的神經網路來逐步去除噪聲。

AdvAD:一種攻擊演算法,旨在對給定圖像產生微不可見的擾動以欺騙模型,它借鑒了擴散過程的理念,但不依賴額外的神經網路進行噪聲預測,而是利用被攻擊模型本身來指導擾動的產生。

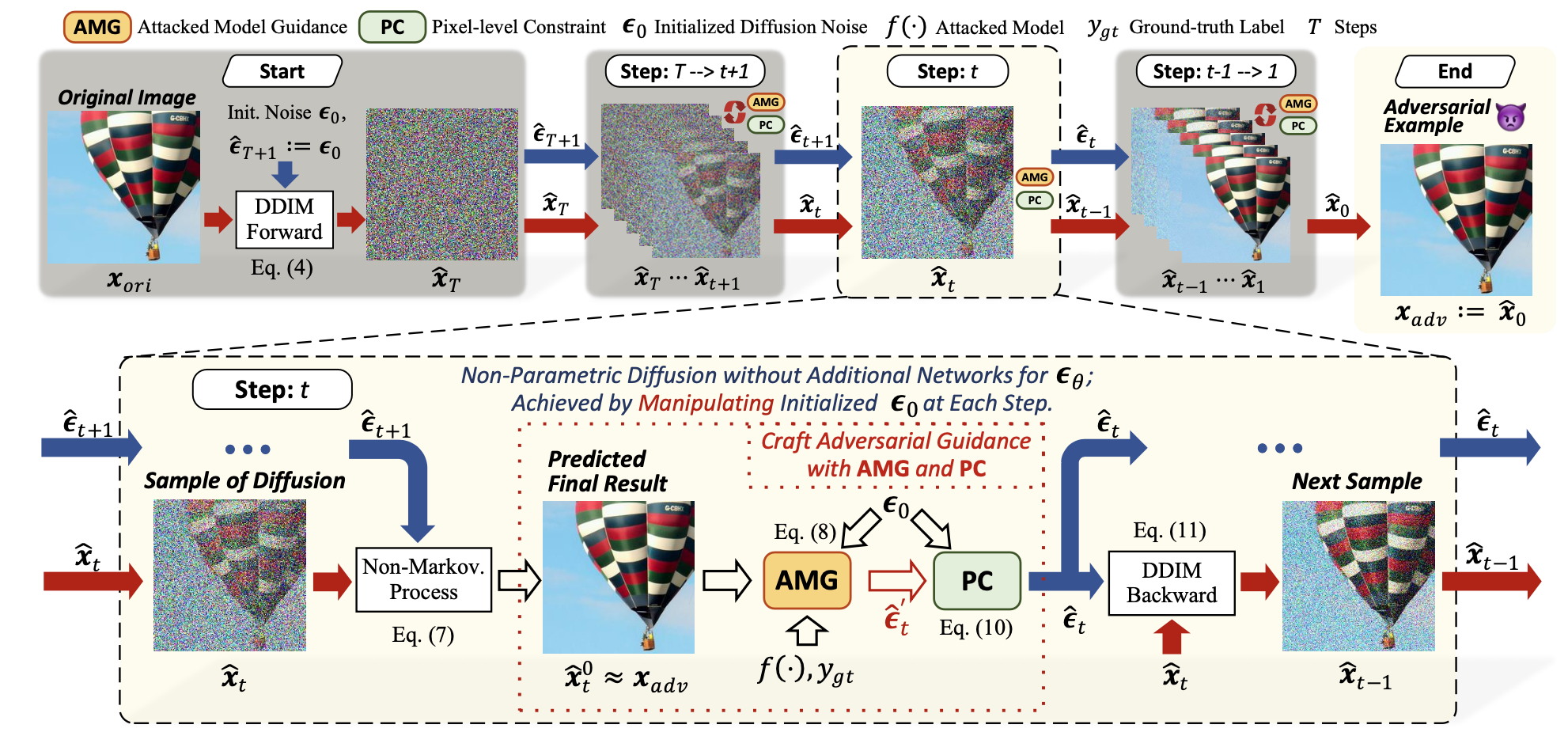

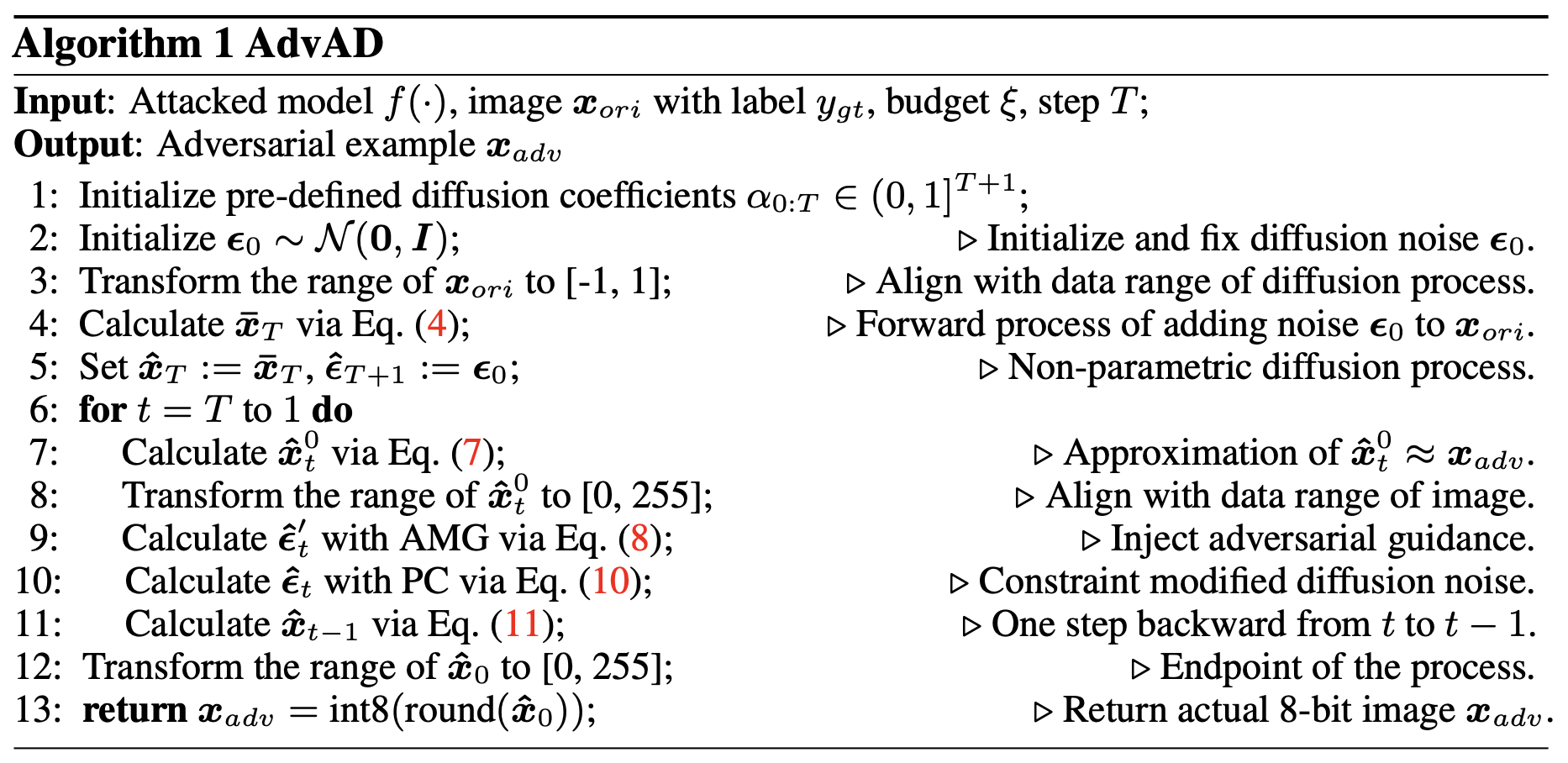

Framework

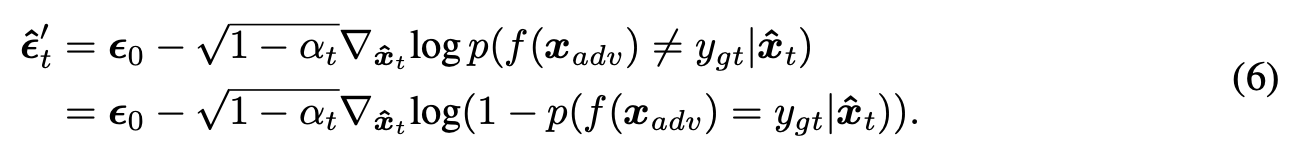

條件採樣技術的引入:作者將 f(xadv)≠ygt 視為一個「對抗性條件」,並運用擴散模型中的條件採樣技術來操縱擴散噪聲以達成此目標 。

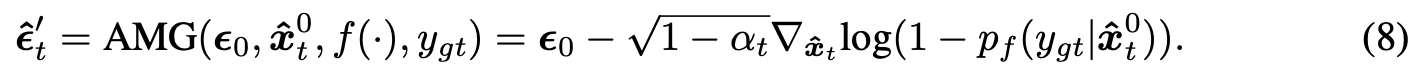

AMG (Attacked Model Guidance)

AMG模組將攻擊過程視為通過非參數化擴散過程的分布到分布轉換,理論上整合了擴散模型的條件採樣技術,僅使用被攻擊的模型f(·)來產生對抗性指導,無需額外神經網絡。

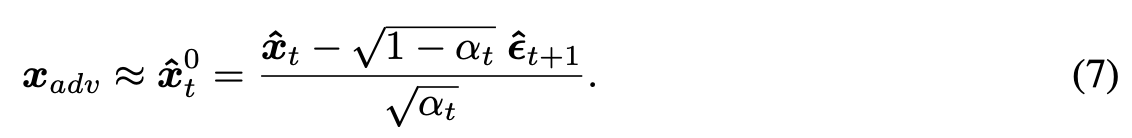

解決 xadv 未知問題(使用前一步的擴散噪聲 ϵ^t+1 來計算當前步驟 t 對最終結果的預測 x^t0,並用它來近似 xadv ):

AMG 方程式的最終形式(僅使用被攻擊模型 f(⋅) 就能將對抗性指導注入到初始化的擴散噪聲中,無需額外網路 。):

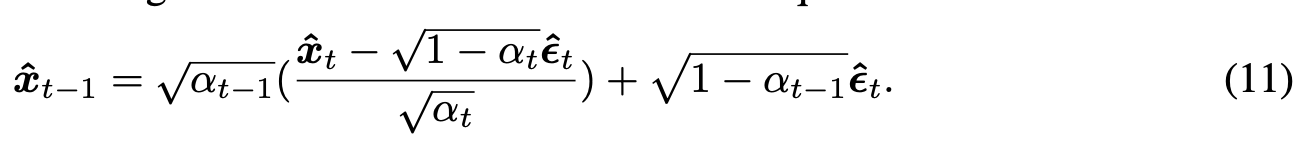

PC (Pixel-level Constraint)

PC模組與AMG協作,對修改後的擴散軌跡施加精確控制,確保擾動在預算範圍內,同時保持攻擊有效性。

DisDiff vs AdvAD

DisDiff (Disrupting Diffusion):

目標:通過對抗性攻擊來擾亂基於擴散模型的個性化定制(如 DreamBooth),以保護用戶隱私 。

核心機制:

Cross-Attention Erasure (CAE):通過”擦除”與特定主體標識符相關的交叉注意力圖來擾亂文本指導 。

Merit Sampling Scheduler (MSS):根據時間步的重要性自適應地調整 PGD 攻擊中的擾動更新幅度 。

它主要關注的是破壞模型學習特定主體與標識符之間聯繫的能力,使得生成的圖像無法識別或與原主體不符 。

AdvAD (Adversarial Attacks in Diffusion):

目標:通過非參數擴散過程以固有的較小擾動強度實現對抗攻擊,目標是使分類器誤分類。

核心機制:

Attacked Model Guidance (AMG):僅使用被攻擊模型本身來產生對抗性指導,修改初始固定的擴散噪聲。

Pixel-level Constraint (PC):約束修改後的擴散噪聲,使其與初始噪聲的差異在一定範圍內,以保證不可感知性和攻擊的有效性。

它著重於通過精確控制擴散軌跡來實現低擾動的攻擊,使最終圖像被誤分類。