📖 RGCL

📖 RGCL

Cite as: ACL 2024

Submitted on 2023/11

Problems

Confounder Memes(混淆梗圖)問題: 圖像或文本的微小差異可能導致完全不同的含義

現有CLIP-based系統的embedding space對細微差異不敏感

混淆梗圖在embedding space中距離過近,難以區分

→ 論文發現HateCLIPper等現有模型將相反標籤的混淆梗圖映射到embedding space的相似位置,導致分類錯誤。

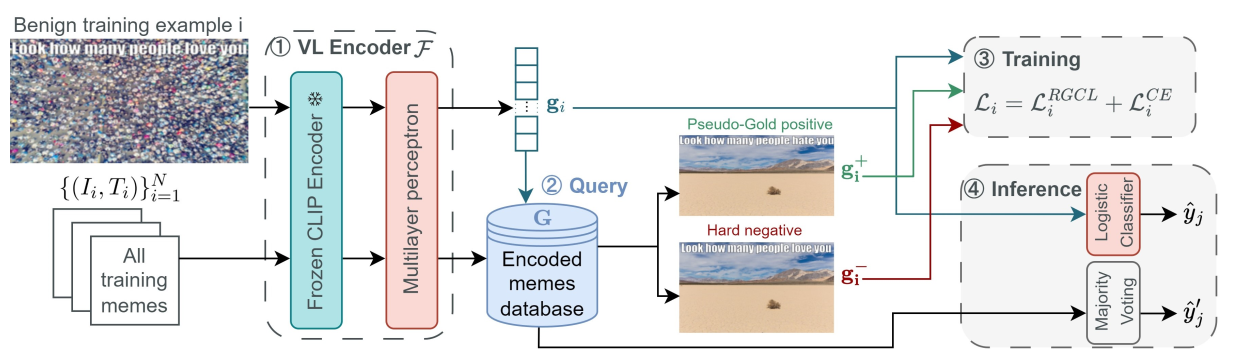

Framework

Retrieval-Guided Contrastive Learning (RGCL)

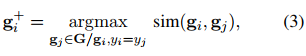

- Pseudo-Gold Positive

定義: 與anchor meme同標籤且高相似度的訓練樣本

作用: 將語義相似的同類梗圖在embedding space中拉近

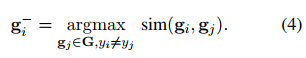

- Hard Negative

定義: 與anchor meme異標籤但高相似度的訓練樣本(通常是confounders)

作用: 增強embedding space區分混淆梗圖的能力

- In-Batch Negative

定義: 同batch中異標籤的所有樣本

作用: 引入多樣化梯度信號,推開隨機負樣本

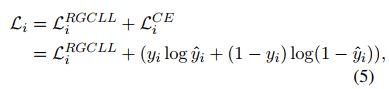

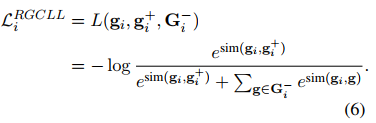

RGCL損失函數:

(LiCE)Cross-Entropy Loss: 讓模型學會基本的分類

目的: 告訴模型「雖然這兩張圖長得不太一樣,但它們語義很近,要拉近距離」。

This post is licensed under CC BY 4.0 by the author.